Inhaltsverzeichnis

In den letzten zwei Jahren haben wir eine beispiellose technologische Goldgräberstimmung erlebt. Nahezu jedes Unternehmen hat versucht, ein Stück vom KI Kuchen zu ergattern. Doch während die Marketingabteilungen die neuesten KI Features feiern, tickt im Hintergrund eine haftungsrechtliche Zeitbombe.

Die aktuellen Zahlen zeigen ein gefährliches Paradox: Laut DAX Digital Monitor weisen rund 95% der DAX Unternehmen Digitalkompetenz in ihren Aufsichtsräten aus – doch diese basiert häufig auf Selbsteinschätzung und ist in vielen Fällen nicht belegbar. Gleichzeitig erfüllen nur noch 30% der Unternehmen überhaupt die grundlegenden Kriterien für Digital Leadership.

Mit anderen Worten: Auf dem Papier ist Kompetenz fast flächendeckend vorhanden – in der Realität fehlt sie in der Breite. Genau in den Boards, die strategische Technologieentscheidungen kontrollieren und bei wesentlichen Investitionen zustimmen müssen, entsteht so ein strukturelles Verständnisdefizit. Und das in einem Umfeld, in dem der EU AI Act Bußgelder von bis zu 7 % des weltweiten Jahresumsatzes vorsieht.

Wir delegieren kritische KI und Datenrisiken in die IT Abteilung und behandeln sie als rein technisches Problem. Doch während der Aufsichtsrat rechtlich den Kopf hinhalten muss, tappt er bei den strategischen und regulatorischen Implikationen häufig im Dunkeln. Im Jahr 2026 ist das kein kalkulierbares Risiko mehr, sondern ein erhebliches Governance und Haftungsrisiko.

Die Illusion der Delegation ist Geschichte

Lange Zeit war es in deutschen Chefetagen normal, komplexe technische Themen nach „unten“ zu delegieren. Man kaufte Software ein, vertraute auf die IT Leitung und hakte das Thema Digitalisierung ab. Doch seit der EU AI Act 2026 vollumfänglich greift, ist diese Ära der Bequemlichkeit endgültig beendet.

Die Regulierung macht unmissverständlich klar: KI Systeme sind häufig systemkritische Infrastruktur. Wenn ein Algorithmus bei der Kreditvergabe diskriminiert, im Recruiting Bias zeigt oder finanzielle Fehlentscheidungen provoziert, haftet das Unternehmen – und zwar mit hohen Bußgeldern.

Für Aufsichtsräte und Vorstände bedeutet das: KI Governance wird zur zentralen Überwachungsaufgabe. Die Gesamtverantwortung lässt sich nicht delegieren. Im Rahmen der Business Judgment Rule müssen Entscheider heute sicherstellen, dass sie die Risiken ihrer Technologieeinsätze verstanden und angemessen bewertet haben. Wer hier auf den weit verbreiteten „Schulungs Geiz“ setzt, verlässt sich auf ein zu schwaches Fundament und erhöht sein Haftungsrisiko. Auch in 2026 ist Unwissenheit keine Verteidigungsstrategie, sondern kann im schlimmsten Fall zur Pflichtverletzung werden.

Investment auf Treibsand: Wie fehlende KI Governance zum Exit Killer wird

Wir müssen aufhören, KI Ethik als optionales Nice to have zu behandeln. In einer datengetriebenen Ökonomie ist KI Governance ein zentraler Bestandteil des Risikomanagements.

Besonders für Gründer und Investoren gilt: Eine mangelhafte KI Governance ist 2026 das größte unsichtbare Risiko für die Bewertung. Zwar treibt die aktuelle Goldgräberstimmung viele VCs dazu, bei der Due Diligence beide Augen zuzudrücken, solange die Umsatzversprechen stimmen – oft auch, weil sie die technischen Risiken selbst nicht richtig bewerten können. Doch dieses Spiel auf Zeit endet spätestens beim Exit oder der nächsten Finanzierungsrunde. Wenn dann ein Investor oder Käufer mit entsprechender Expertise das unkalkulierbare Risiko entdeckt, wird die vermeintliche Goldgrube zum Deal Breaker.

Echte technologische Souveränität entsteht erst dann, wenn das Board klare Governance Leitplanken für den Einsatz von KI setzt. Wer blind auf externe Modelle vertraut, ohne eigene Kontrollmechanismen zu definieren, baut sein Business auf Treibsand.

Leadership Resilienz: Die Blackbox durchleuchten

Die entscheidende Frage für die C Suite lautet: Wie führt und überwacht man ein Unternehmen, dessen Kernprozesse von KI Systemen gesteuert werden, die man selbst nicht versteht? Die Antwort liegt in einer neuen Form der Leadership Resilienz.

Ein modernes Board muss in der Lage sein, das Governance Framework für den Einsatz von KI zu prüfen. Doch genau hier zeigt sich in der Praxis eine strukturelle Schwäche: In vielen Boards fehlt es weiterhin an tiefgehender Technologie und KI Expertise, um dieser Verantwortung wirklich gerecht zu werden.

Dabei dürfen wir uns nicht täuschen lassen: Oberflächliche Schulungen sind 2026 nur noch das absolute Minimum. KI Expertise sitzt meistens noch am Katzentisch – ohne echten Einfluss. Der entscheidende Hebel ist die strukturelle Verankerung direkt im Gremium, sei es durch die Besetzung des Aufsichtsrats oder die dauerhafte Einbindung externer Spezialisten. Es geht nicht darum, den Code zu lesen, sondern das Framework zu validieren:

Nach welchen spezifischen Kriterien wurde die KI getestet?

Welche regulatorischen Schwellenwerte des EU AI Act sind für unser Geschäftsmodell kritisch?

Wie sieht der „Human in the loop“ Prozess aus, um algorithmische Fehlentscheidungen jederzeit korrigieren zu können?

Ein resilientes Board lebt fachliche Diversität. Wir brauchen technische Expertise am Tisch, die Komplexität in rechtliche Sicherheit übersetzt.

Fazit: Governance als Wettbewerbsvorteil

Der erste Hype um KI ist der harten Realität der Regulierung gewichen. Was bleibt, ist die drängende Frage der persönlichen Verantwortung. Gründer, Investoren und Vorstände, die KI Governance als Teil ihrer strategischen DNA begreifen, gehen als Gewinner aus dieser Transformation hervor. Nicht, weil sie „ethischer“ handeln, sondern weil sie ihre Hausaufgaben im Risikomanagement gemacht haben.

Es ist Zeit, den fachlichen Stillstand zu beenden. Die Frage ist nicht mehr, ob die KI kommt – sie prägt bereits zentrale Prozesse und Geschäftsmodelle unserer Wirtschaft. Die Frage ist, ob Sie als Führungskraft bereit sind, die Verantwortung für diese Steuerung zu übernehmen, bevor der erste 7 Prozent Bescheid auf dem Tisch liegt.

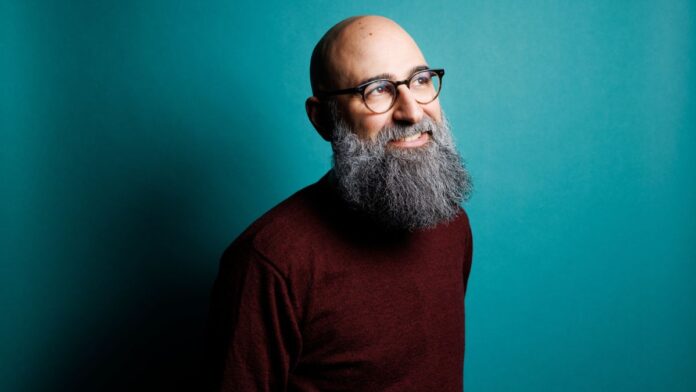

Bild: Fotograf: Peter Rigaud

Aussagen des Autors und des Interviewpartners geben nicht unbedingt die Meinung der Redaktion und des Verlags wieder.